La utilización de algoritmos de Inteligencia Artificial que rastrean nuestra huella digital allá por donde vamos y nos ofrecen consejos en función de nuestro rastro abre toda una variedad de dudas éticas sobre si permitimos a los turistas elegir con libertad su destino o teledirigimos sus decisiones cuando realizamos campañas publicitarias hipersegmentadas y ofrecemos servicios personalizados al detalle.

¿Qué opinas? ¿Dónde está la línea para garantizar que tu cliente reciba tu servicio de una forma positiva, no invasiva?

La ética es la respuesta para seguir consiguiendo que nuestro turista se sienta como en casa, como en su espacio de mayor intimidad y seguridad.

¿Quieres usar alguna herramienta en tu destino o empresa que analice tus datos y tome decisiones?

La Guía de Casos de Uso de Inteligencia Artificial y Ética en el sector turístico publicada por Turisme Comunitat Valenciana a través de Invat·tur te ofrece una serie de recomendaciones que debes tener en cuenta y te muestra ejemplos de herramientas de IA.

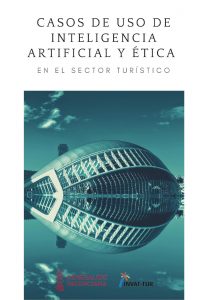

Aunque te aconsejamos descargarla, te resumimos a continuación los principales consejos que apuntaron los expertos y responsables tecnológicos en la presentación de esta Guía dirigida por el director de Inteligencia Turística de Turisme CV, Mario Villar:

GARANTIZA LA TRANSPARENCIA

“Es fundamental respetar la autonomía y libertad de decisión del turista” afirmaba el secretario autonómico de Turisme, Francesc Colomer. Y para ello debe saber y aceptar qué ocurre en todo momento, qué datos suyos se están recopilando, por qué y para qué, si está interactuando con un bot o no, si se está grabando su imagen o su voz, por qué se le ofrecen unas recomendaciones y no otras, etc.

Además, toda esa información debe ser explicada con claridad. “Esto no debe ser un lenguaje de expertos, privativo. En la cultura de la letra pequeña la banca siempre gana y no se trata de eso”, aseguraba Colomer.

Pero ¿cómo asegurar esa claridad para todos?

“Muchas veces aceptamos aplicaciones sin leer el texto legal. Debemos reeducarnos en el uso de internet y las consecuencias que tiene” apuntaba Vicent Roca, CEO de Synergics, empresa que ha creado la herramienta BionTrend para Turisme CV y Hosbec con el fin de que cada hotel tenga un análisis de su situación de negocio con una predicción a un año.

Ahora bien, “las empresas tenemos que ofrecer la información de forma más transparente y usable. Avisar antes de que la aplicación realice cualquier acción” decía Manel Alcaide, CEO de Visualfy Places, empresa que ofrece soluciones tecnológicas que reconocen los sonidos y los transforma en señales visuales para facilitar el movimiento de personas sordas.

“En muchas ocasiones encontramos formularios de términos de uso ilegibles, poco usables, deberíamos encontrar un método más fácil y tranquilizador para el usuario” reconocía Carlos Sendra, director de marketing de Mabrian, empresa que analiza la información que los propios turistas publican en sus redes sociales.

Para Sendra, demasiada información y petición de permisos resulta poco usable y genera mayor desconfianza al usuario. “¿Por qué no estandarizar las normas de uso a nivel internacional para no tener que dar permisos cada vez que entras a un sitio u otro?” se preguntaba el responsable de Mabrian.

DETERMINA LA RESPONSABILIDAD

Además de la transparencia (cómo y por qué obtengo estos resultados o recomendaciones), resulta muy importante la responsabilidad (quién es el creador del algoritmo que da esos resultados), comentaba Karen Blanco, de Air DNA, empresa que analiza la oferta on line de alquiler turístico.

¿A quién pedimos responsabilidades de una acción si la ha ejecutado una herramienta tecnológica de IA? Es necesario saber con exactitud a quién atribuir una acción o decisión, ser capaces de explicar todo el proceso operativo y tener garantías de protección ante posibles ciberataques.

PROTEGE LA PRIVACIDAD

“La desconfianza hacia la Inteligencia Artificial es muy importante. Se trata de soluciones de alto riesgo para la privacidad” decía Manel Alcaide.

Ante este riesgo, la principal solución expresada por los diferentes expertos fue la de recoger grandes volúmenes de datos anónimos e impedir la identificación personal, incluso en los casos de grabación de imagen o reconocimiento facial.

Además, en el caso en que una información personal se vaya a utilizar, por ejemplo, en alguna recomendación o promoción personalizada, se debe solicitar antes el consentimiento y explicar las ventajas que recibirá el cliente a cambio, como hace Bee the Data, otra de las empresas citada en la guía.

No envíar los datos fuera de la instalación donde se recogen o incluso eliminarlos una vez procesados son otras de las garantías recomendadas.

En el caso de VisualFy, por ejemplo, tuvieron que poner micrófonos en espacios públicos y particulares para grabar todo tipo de sonidos pero permitían al usuario escuchar la grabación antes y dar su consentimiento, además de garantizar que el sonido era borrado a los dos minutos de ser reconocido.

VIGILA EL RIGOR

La calidad de los datos que analiza el algoritmo influye directamente en el rigor de sus resultados. Así pues, para garantizar la veracidad se debe reducir cualquier sesgo o desviación en la recopilación y aquí puede ser imprescindible destinar personal a la supervisión.

Contaba Vicent Roca, que en los primeros resultados de la herramienta BionTrend obtuvieron que Afganistan era el país con más cancelaciones pero la causa era que cuando el hotel no rellenaba el dato de país de origen, el sistema por defecto añadía el primero de la lista, que sigue un orden alfabético.